Information Technology Reference

In-Depth Information

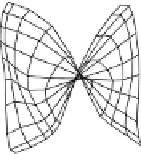

Abbildung 7.10: Bei ungünstiger Initia-

lisierung, zu geringer Lernrate oder zu

kleiner Nachbarschaft kann es zu Ver-

drehungen der Karte kommen.

Intervall

[

0.5, 0.5

]

gezeigt. Wegen der Zufälligkeit der Initialisierung ist die (relati-

ve) Lage der Referenzvektoren von der (relativen) Lage der Ausgabeneuronen noch

völlig unabhängig, so dass keinerlei Gitterstruktur zu erkennen ist.

Die folgenden Diagramme (erst obere Zeile von links nach rechts, dann unte-

re Zeile von links nach rechts) zeigen den Zustand der selbstorganisierenden Karte

nach 10, 20, 40, 80 und 160 Trainingsschritten (je Trainingsschritt wird ein Lernmu-

ster verarbeitet, Lernrate

(

t

)=

0.6

·

t

0.1

, Gaußsche Nachbarschaftsfunktion

f

nb

,

Nachbarschaftsradius

(

t

)=

2.5

·

t

0.1

). Man sieht sehr schön, wie sich die selbstor-

ganisierende Karte langsam „entfaltet“ und sich so dem Eingaberaum anpasst. Das

Sichtbarwerden der Gitterstruktur zeigt, wie die Anordnung der Ausgabeneuronen

auf die Anordnung der Referenzvektoren im Eingaberaum übertragen wird.

Für das gleiche Beispiel zeigt Abbildung 7.9 die Visualisierung einer selbstorga-

nisierenden Karte, auf die wir in Abschnitt 7.1 hingewiesen haben. Alle Diagram-

me zeigen die Gitterstruktur der Ausgabeneuronen (

nicht

den Eingaberaum wie in

Abbildung 7.8), wobei jedem Neuron ein kleines Quadrat zugeordnet ist (verglei-

che auch Abbildung 7.1 auf Seite 102). Die Graustufen stellen die Aktivierung der

Ausgabeneuronen bei Eingabe des Musters (0.5, 0.5) unter Verwendung einer

Gaußschen Aktivierungsfunktion dar: Je dunkler ein Quadrat ist, umso höher ist die

Aktivierung des zugehörigen Neurons. Auch mit dieser Darstellung lässt sich das

Training gut verfolgen. Nach der Initialisierung sind die stark aktivierten Neuronen

noch zufällig auf der Karte verteilt. Mit fortschreitendem Training ordnen sie sich

jedoch immer stärker zusammen. Man beachte die Aktivierungsstrukturen nach 20

(3. Diagramm) und nach 40 Lernmustern (4. Diagramm) und vergleiche sie mit den

zugehörigen Darstellungen der selbstorganisierenden Karte im Eingaberaum in Ab-

bildung 7.8: Da die Karte in diesen Phasen auf der linken Seite noch unvollständig

entfaltet ist, sind viele Neuronen auf der linken Seite der Karte stark aktiviert.

Das gerade betrachtete Beispiel zeigt einen beinahe idealen Verlauf des Trainings

einer selbstorganisierenden Karte. Nach nur wenigen Trainingsschritten ist die Karte

bereits entfaltet und hat sich den Lernmustern sehr gut angepasst. Durch weiteres

Tra ining wi rd di e Kar te noch e twas gedehnt , bi s s i e den Bere i ch der Lernmus ter

gleichmäßig abdeckt (wenn die Projektion des Neuronengitters auch, wie man sich

leicht überlegen kann, nie ganz die Ränder des Quadrates

[

1, 1

] [

1, 1

]

erreicht).

Das ist jedoch nicht immer so. Wenn die Initialisierung ungünstig ist, besonders

aber, wenn die Lernrate oder der Nachbarschaftsradius zu klein gewählt werden

oder zu schnell abnehmen, kann es zu „Verdrehungen“ der Karte kommen. Für das

gerade betrachtete Beispiel ist ein Ergebnis eines in dieser Weise fehlgeschlagenen

Tra inings in Abbi ldung 7 . 10 geze igt . Di e Kar te ha t s i ch ni cht r i cht ig ent fa l te t . Di e

Ecken des Eingabequadrates sind den Ecken des Gitters „falsch“ zugeordnet wor-