Information Technology Reference

In-Depth Information

und die neuronale Verbindung trainieren konnte, verdrängt

in dieser Hinsicht erfolglose Neurone. In einer Lernphase

könnte für 3 × 7 nicht nur 21, sondern genau so 19 „wahr“

sein. Erst das wiederholte positive Feedback sichert das

korrekte Ergebnis im Gehirn. Nach wenigen Monaten ver-

fügt ein Baby über 1/3 mehr Verbindungen als später der

Erwachsene. Im visuellen Cortex etwa wird ein Maximum

der Synapsendichte im 8. Lebensmonat erreicht, wenn das

Kind Gesichter vollständig erfassen und genauer unterschei-

den kann als im späteren Leben. Man kann das Phänomen

des eidetischen Gedächtnisses beobachten, wobei zahllose

Einzelheiten eines Bildes längere Zeit gespeichert werden,

was bei Erwachsenen nur nach einer Hirnschädigung (Insel-

begabte, Savants) und ansatzweise am ehesten noch bei Au-

tisten beobachtet werden kann - Menschen mit Deiziten für

Kommunikation aber Neigung zu systematischem Denken.

Das gewaltige Erinnerungsvermögen einzelner Menschen an

Einzelheiten über Jahrzehnte hinweg hat zu der Hypothese

geführt, dass grundsätzlich alle Eindrücke gespeichert blei-

ben und nur der Zugang dazu bei fast allen Menschen norma-

lerweise verloren geht. Diese Hypothese bedeutet, nur der für

Erinnern nötige rückwärtige Teil der speziellen Verschaltung

der Signalwege würde abgebaut. Allerdings gibt es auch Be-

obachtungen, dass diese für eine Erinnerung notwendigen

Verschaltungen unter speziellen äußeren Impulsen wieder

aktiviert werden können.

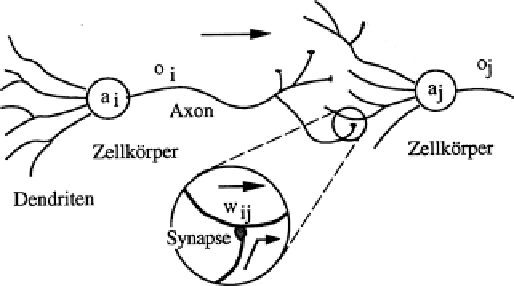

Zur Modellierung des unterschiedlichen Effektes der

eintreffenden Signale an den verschiedenen Synapsen ei-

ner Nervenzelle, z. B. erregender oder hemmender Effekt,

besitzen die Synapsen ein Verbindungsgewicht. Betrag und

Vorzeichen dieses Gewichtes bestimmen den Einluss dieser

Synapse (aktivierend oder hemmend).

r

w

:

:

x

x

2

.

.

x

w

1

o

x

rr

w

2

x

rr

(, )

f

a

( (, ))

f

f

a

w

n

Abb. 3.7

Darstellung eines künstlichen Neurons

Formal kann ein einzelnes künstliches Neuron mathema-

tisch beschrieben werden durch (

Abb. 3.7

)

• einen Eingabevektor

x

, der die Eingangssignale der

Vorgänger-Neuronen enthält

• einen Gewichtsvektor

w

, zur Modellierung des Verhal-

tens einer Synapse

• einer Aktivierungsfunktion

f

a

• einer Ausgabefunktion

f

0

.

Häuig wird als Aktivierungsfunktion die gewichtete

Summe

n

3.3

Künstliche Neuronale Netze

f

(, ):

xw

=

∑

=1

xw

a

i

i

i

3.3.1

Prinzipien

verwendet.

Der Ausgabebereich eines Neurons wird in der techni-

schen Realisierung unterschiedlich dargestellt. Unterschieden

werden (quasi-)kontinuierliche und diskrete Wertebereiche.

Im Falle kontinuierlicher Wertebereiche unterscheidet man

wiederum Modelle, die alle reellen Zahlen als Werte zulassen

und Modelle, die nur ein Intervall verwenden. Die meisten

Modelle beschränken die Ausgabe auf ein Intervall, beispiels-

weise [0,1] oder [−1, +1]. Bedingt ist dies durch die Verwen-

dung von nichtlinearen, häuig sigmoiden Ausgabefunktio-

nen. Manche Modelle verwenden aus theoretischen Gründen

diskrete Aktivierungszustände, wie etwa das ursprüngliche

Hopield-Modell. Diese werden dann beispielsweise auch

in einer Implementierung als binäre Werte gespeichert und

verarbeitet.

Die Ausgabefunktion, die die Ausgabe

o

erzeugt

,

kann auf

unterschiedliche Arten realisiert werden. Bei der Vorstellung

von biologischen Neuronen wurde gezeigt, dass für die Aus-

lösung eines Aktionspotenzials ein gewisser Schwellenwert

S

überschritten werden muss. Dies motiviert die Verwendung

einer binären Schwellenwertfunktion:

Die Bestandteile eines Künstlichen Neuronalen Netzwerks

sind die von stark idealisierten Neuronen. Sie bestehen - in

Anlehnung an das biologische Vorbild (s.

Abb. 3.5

) - aus drei

Komponenten: einem Zellkörper (Zellkern, body),

den Dendri-

ten, welche die Eingabe des Netzes in die Zelle aufsummieren,

und einem Axon, welches die Ausgabe einer Zelle nach außen

weiterleitet, sich verzweigt und mit den Dendriten nachfol-

gender Neuronen über Synapsen in Kontakt tritt (

Abb. 3.6

).

Abb. 3.6

Idealisierung zweier Neuronen und ihrer Vernetzung